John Searle: La habitación china y los límites de la simulación

¿Es posible que un programa informático entienda el lenguaje o solo opera con símbolos sin comprender nada? La pregunta formulada por John Searle en 1980, a través de su célebre experimento mental de la “habitación china”, se ha transformado en el reto filosófico más constante para la inteligencia artificial (AI). Cuando hoy festejamos los éxitos de Claude o ChatGPT, cuando estos sistemas responden a preguntas con una supuesta comprensión, la habitación china nos acecha: ¿hay alguien en casa o solo hay un sofisticado juego de manipulación sintáctica?

Para comprender la razón por la que Searle planteó esta objeción tan devastadora, así como por qué aún continúan las acaloradas discusiones al respecto, es necesario ubicarnos en el ámbito intelectual de los años setenta, cuando la IA vivía su primer periodo dorado y filósofos como Searle empezaban a cuestionarse si los entusiastas de la IA confundían simulación con realidad.

Berkeley durante la década de los sesenta: filosofía y revolución

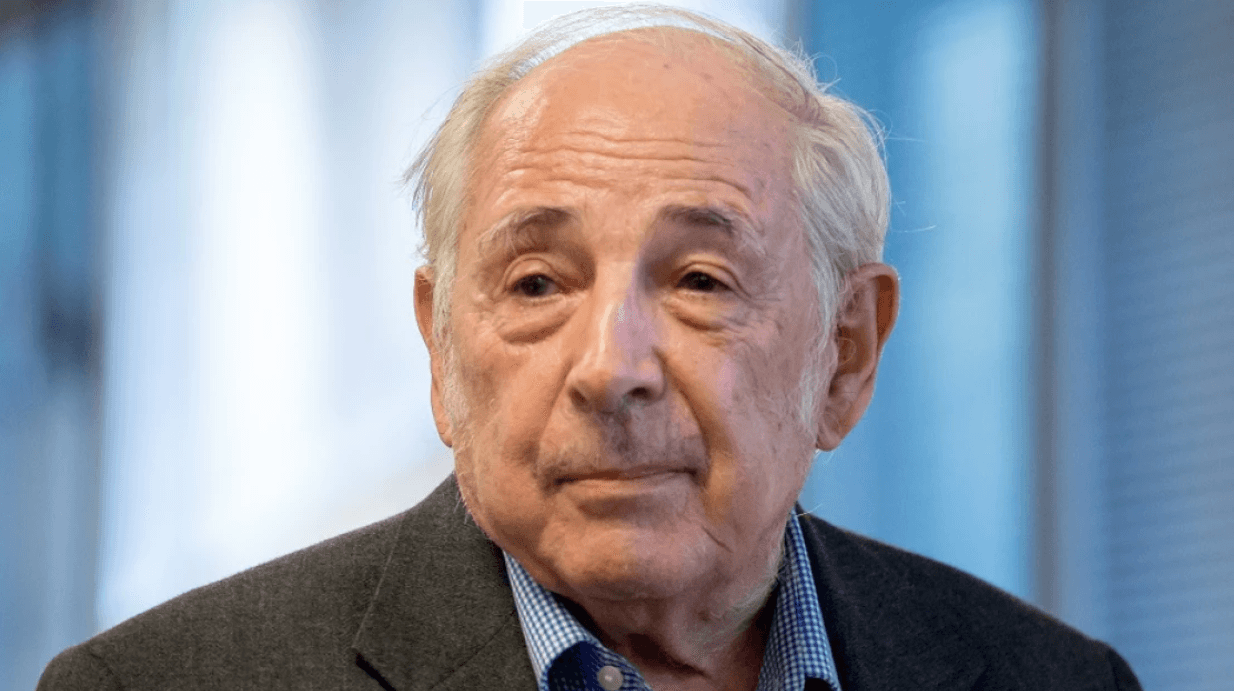

John Rogers Searle, nacido en 1932 en Denver, Colorado, vino al mundo durante la Gran Depresión. No obstante, fue en Berkeley, California, donde su pensamiento maduraría y donde desarrollaría casi toda su carrera académica a partir de 1959. Berkeley no era un sitio cualquiera: era el centro de la contracultura estadounidense, así como del Movimiento por la Libertad de Expresión y de las manifestaciones multitudinarias contra Vietnam.

Berkeley vivió en las décadas de los sesenta y setenta una efervescencia política e intelectual sin igual. En 1964, el campus estalló con el Movimiento por la Libertad de Expresión (Free Speech Movement), donde los alumnos reclamaban libertad política en un entorno que consideraban administrativamente autoritario. Searle, un joven profesor de filosofía, se vio involucrado en estos conflictos. No fue un radical, pues criticó algunas cosas excesivas del movimiento estudiantil; sin embargo, tampoco se mantuvo al margen. Esta vivencia política específica, de discusiones sobre legitimidad y poder en las calles y en las aulas, cultivó en Searle una sensibilidad especial: desconfianza hacia abstracciones ajenas a la realidad social y un enfoque en cómo funciona el mundo realmente.

Al mismo tiempo, Berkeley era un núcleo de investigación científica a nivel global. La psicología, la lingüística y la IA estaban sufriendo una transformación debido a la revolución cognitiva. El laboratorio vecino de IA de Stanford, establecido en 1963 por John McCarthy, era un centro de optimismo: había quienes pensaban que las máquinas verdaderamente inteligentes estaban a la vuelta de la esquina. Searle respiraba este aire de promesas tecnológicas, pero a la vez desarrollaba un escepticismo filosófico que lo conduciría a ser uno de los más incisivos críticos de la IA fuerte.

Desde Oxford a la filosofía del lenguaje cotidiano

Searle había asistido a Oxford de 1952 a 1959, cuando la filosofía del lenguaje ordinario se encontraba en su apogeo. Esta tendencia, vinculada con personalidades como Gilbert Ryle y J.L. Austin, afirmaba que numerosas cuestiones filosóficas tradicionales nacían de malentendidos acerca de cómo utilizamos el lenguaje en realidad. No teníamos que desarrollar teorías abstractas, sino observar con atención la manera en que el lenguaje opera en la vida diaria.

Austin, el director de tesis de Searle, desarrolló la teoría de los “actos del habla”: al decir algo no solo describimos el mundo, sino que también hacemos cosas. Son actos que se llevan a cabo por medio de palabras: bautizar, ordenar y prometer. Esta sencilla idea tenía profundas consecuencias: el lenguaje no es solo un reflejo pasivo de la realidad, sino que también es una forma de acción social.

Speech Acts (1969), el primer libro significativo de Searle, fue donde él estableció una teoría sistemática sobre la manera en que las palabras operan en contextos sociales. Para Searle, el lenguaje era sobre todo una institución social que se regía por reglas constitutivas. Entender el lenguaje no solo era conocer la gramática o las palabras, sino también tener dominio de prácticas sociales complejas, interpretar intenciones y reconocer contextos.

Esta capacitación en la filosofía del lenguaje ordinario determinaría su crítica a la IA más adelante. Según Searle, los aficionados a la IA cometían un error categorial: confundían el manejo formal de símbolos con la verdadera comprensión que solo tiene lugar en entes con experiencia subjetiva que participan en prácticas sociales.

El funcionalismo y la inteligencia artificial: la ortodoxia que Searle cuestionaría

La IA experimentó un periodo de optimismo desbordante durante la década de 1970. SHRDLU (1970) es un programa que tenía la capacidad de sostener conversaciones sobre un mundo de bloques, contestando preguntas y llevando a cabo órdenes. ELIZA (1966) imitaba diálogos terapéuticos de manera tan persuasiva que había usuarios que creían estar hablando con un terapeuta verdadero. Estos logros reforzaban la idea de que la inteligencia humana era, en esencia, procesamiento de información: manipulación de símbolos conforme a ciertas reglas.

El funcionalismo se volvió la postura predominante en el campo de la filosofía de la mente. El funcionalismo, propuesto por Hilary Putnam y otros, afirmaba que los estados mentales se caracterizan no por su implementación física, sino por sus roles funcionales: sus vínculos causales con inputs, outputs y otros estados mentales. Si una computadora y un cerebro biológico fueran capaces de ejecutar las mismas tareas, tendrían los mismos estados mentales. El software era la mente y el hardware, el cerebro.

Esta perspectiva tuvo un impacto inmediato en la IA: si un programa tuviera la capacidad de duplicar las funciones de la mente humana, dicho programa sería consciente, comprensivo e inteligente. No sería una simulación de inteligencia, sino que la inteligencia real se aplicaría en un sustrato distinto. Searle pensaba que esto estaba profundamente equivocado. Y en 1980, publicó “Minds, Brains, and Programs” en Behavioral and Brain Sciences, que incluía un experimento mental creado para refutar la “IA fuerte”.

La habitación china: el experimento que transformó la discusión

Searle sugirió que imagináramos una habitación cerrada. Hay alguien adentro que no habla chino. Posee un manual riguroso en inglés con normas para manejar símbolos chinos: si recibe estos símbolos a través de una ranura, tiene que buscar en el manual y enviar otros símbolos por otra ranura. Desde afuera, individuos que hablan chino envían preguntas redactadas en ese idioma. La persona en la habitación sigue las normas del manual y proporciona respuestas. Para quienes observan desde afuera, las respuestas son perfectas, no se pueden diferenciar de las que daría un hablante nativo.

Pero preguntaba Searle: ¿entiende el individuo en la habitación el chino? Por supuesto que no. Únicamente opera con símbolos de acuerdo con reglas sintácticas sin entender su sentido. No solo eso, fue más allá al afirmar: el programa de computadora es la persona que está en la habitación. Realiza exactamente lo que hace cualquier software: manipular símbolos formales con base en reglas. Si una persona no entiende el chino, aunque produzca respuestas correctas, entonces ningún programa comprende verdaderamente nada, independientemente de cuán avanzado sea su comportamiento.

La habitación china atacó de manera directa el Test de Turing. Searle admitía que un programa podría superar la prueba —comportarse de manera idéntica a una persona inteligente—, pero enfatizaba que esto no significaba una comprensión verdadera. Al realizar el examen, se demostraba competencia sintáctica, no la comprensión semántica. La semántica nunca es suficiente únicamente con la sintaxis.

En la filosofía de la IA, esta separación entre “IA fuerte” (software que verdaderamente entiende) e “IA débil” (software que imita la comprensión de manera útil) se volvió fundamental. Searle abogaba por la IA débil: las computadoras son instrumentos potentes para simular procesos cognitivos. Sin embargo, rechazaba la IA fuerte: ningún software tiene, por sí mismo, estados mentales genuinos.

El problema de la conciencia y la intencionalidad

El argumento de Searle se basaba en su teoría de la intencionalidad. Los estados mentales genuinos tienen “intencionalidad”: son sobre algo, se refieren a cosas en el mundo, tienen contenido. Mi creencia sobre París es acerca de esa ciudad; mi deseo de un café se dirige a esa bebida específica. Esta “direccionalidad” hacia el mundo es una característica fundamental de la mente.

Searle sostenía que la intencionalidad no tiene la posibilidad de ser reducida a conexiones funcionales o computacionales. Proviene de características biológicas particulares del cerebro. En una computadora, los símbolos no poseen una intencionalidad inherente; el sentido que les otorgamos es un significado derivado, establecido por nosotros, los intérpretes. Las palabras de un libro no tienen sentido por sí mismas hasta que son interpretadas por un lector consciente.

Este acento en la biología era a propósito provocador. Searle afirmaba que la conciencia es un fenómeno biológico que se origina a partir de procesos cerebrales, al igual que la fotosíntesis o la digestión. Tratar de crear conciencia sin la biología era como intentar que una simulación computacional del proceso digestivo digiriera comida de verdad. La simulación puede ser útil para el análisis del proceso, pero no replica el fenómeno real.

El legado: un debate aún sin solución

La habitación china provocó una lluvia de respuestas. Se sugirieron docenas de contradicciones: la “respuesta del sistema” (no es el individuo, sino el sistema entero que entiende), la “respuesta del robot” (se conecta la IA a los sensores y efectores) y la “respuesta del cerebro simulado” (simula no solo símbolos, sino también neuronas). Searle respondió de manera metódica a cada pregunta, enfatizando que ninguna cantidad de manipulación sintáctica produce semántica auténtica.

El debate sigue hasta la actualidad. Cuando GPT-5 redacta ensayos coherentes, cuando sistemas de IA diagnostican patologías o crean música, vuelve a surgir la cuestión de Searle: ¿Están verdaderamente entendiendo lo que hacen, o simplemente están realizando operaciones formales avanzadas sin sentido intrínseco? ¿Hay una diferencia que sea significativa?

Searle nos exige diferenciar entre la comprensión auténtica y el comportamiento inteligente, entre lo simulado y lo real, así como entre función y experiencia subjetiva. En una época en la que los modelos de lenguaje producen textos cada vez más parecidos a los humanos, su habitación china continúa siendo el reto filosófico más difícil: un recordatorio de que quizás confundimos la elocuencia con la comprensión y de que la cuestión de qué significa verdaderamente comprender algo sigue sin respuesta como siempre.

La respuesta que brindemos no es únicamente teórica: definirá la manera en que nos comportamos con las máquinas, qué responsabilidades les asignamos y qué significa ser humano en un mundo poblado de IAs.

Si Searle tiene razón y ningún programa comprende realmente lo que hace, ¿quién es responsable cuando la IA causa daño? ¿El sistema que no comprende, los programadores que no pueden prever todas las consecuencias, o nosotros por tratar como comprensión lo que es solo manipulación sofisticada de símbolos?